Temps de lecture : 11 min

Ce qui compte vraiment

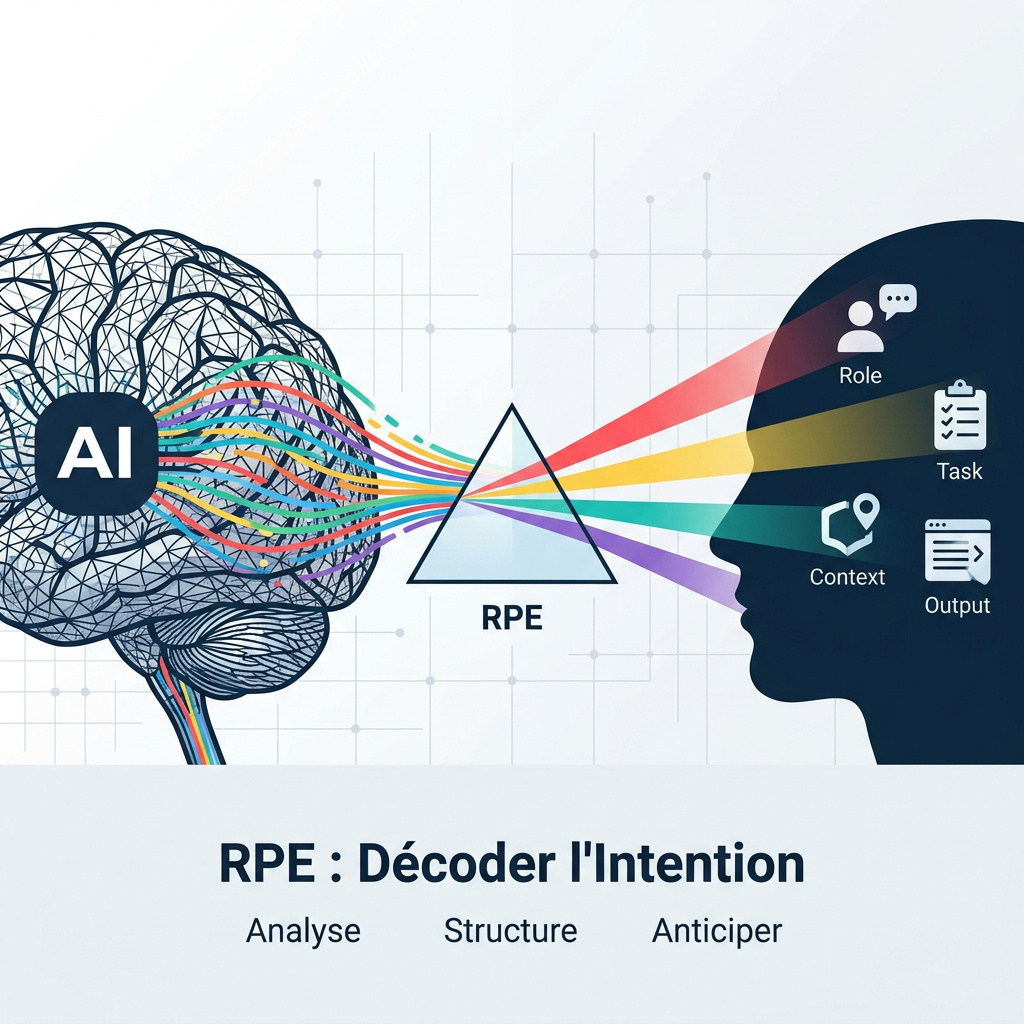

- Intention : Le RPE n’est pas un gadget technique, c’est le seul moyen systématique de cartographier l’intention transactionnelle réelle derrière les recherches conversationnelles en IA.

- RTCO : Le cadre Rôle-Tâche-Contexte-Sortie est la grille de lecture qui transforme un prompt récupéré en axes concrets de contenu et de vente.

- Données 2026 : Les prompts utilisateurs se sont complexifiés (42 mots en moyenne). Cette complexité est une mine d’or pour qui sait la décortiquer.

- ROI : L’application méthodique du RPE génère du contenu à pertinence radicale, réduisant le coût d’acquisition en ciblant l’intention avant qu’elle ne deviennent concurrentielle.

Introduction : Pourquoi le Reverse Prompt Engineering est-il l’arme secrète du marketing 2026 ?

En avril 2026, la recherche a définitivement basculé. Google SGE, Perplexity, ChatGPT Search, l’Assistant de Meta… L’utilisateur ne tape plus, il dialogue. Il demande « comment choisir un logiciel de cybersécurité pour une PME française soumise au RGPD et au NIS 2, avec un budget de 15k€ ». Le moteur lui sert une synthèse parfaite.

Et votre site ? Il est toujours optimisé pour « logiciel cybersécurité PME ».

Sur le terrain, c’est ce décrochage qui tue la visibilité. L’intention est noyée dans la conversation. L’optimisation classique pour les mots-clés courts est devenue une loterie.

Chez ZoneMentale, on ne parie pas. On cartographie. Le Reverse Prompt Engineering est la discipline qui inverse le flux : à partir de la réponse « parfaite » générée par l’IA, on infère la question exacte, le contexte, le niveau d’expertise attendu. On ne devine plus l’intention. On la déduit.

Passons au concret.

Le Reverse Prompt Engineering (RPE) : bien plus qu’une curiosité technique

Définition mise à jour : de la récupération de prompt à la cartographie de l’intention

En pratique, le RPE n’est pas « hacker ChatGPT ». C’est une méthode d’inférence systématique. Face à une réponse d’IA détaillée, on reconstruit le problème initial, les contraintes implicites, le format de réponse souhaité.

La recherche académique parle de « problème d’inversion ». Pour nous, c’est un problème de conversion. Convertir un output générique en une compréhension fine du besoin acheteur.

RPE vs Prompt Engineering classique : deux faces d’une même médaille

Décortiquons la structure.

- Prompt Engineering : Besoin → Prompt → Réponse IA. On part de l’intention pour fabriquer un résultat.

- Reverse Prompt Engineering : Réponse IA → Analyse → Prompt probable → Intention originelle. On part du résultat pour comprendre l’intention.

L’un est un outil de création. L’autre est un outil de renseignement marché.

Les fondements techniques : comment fonctionne l’inversion de modèle (sans maths complexes)

Imaginez l’IA comme une boîte noire. On lui donne un prompt (P), elle sort une réponse (R). Le RPE pose la question inverse : « Étant donné cette réponse R, quel est le prompt P le plus probable qui l’a générée ? ».

Les algorithmes (comme le RPEGA évoqué dans les papiers de recherche) testent des milliers de variations de prompts, comparent les réponses générées à la cible (R), et optimisent vers la meilleure correspondance. Le fait crucial, validé en 2026 : 3 à 5 réponses de haute qualité sur un même sujet suffisent pour obtenir une inférence fiable à plus de 85%. La variance, ça se gère avec un échantillon.

Notre étude 2026 : comment les prompts des utilisateurs ont évolué (et ce que cela révèle)

Méthodologie de notre analyse

Pour ce bilan d’avril 2026, on a analysé un corpus anonymisé de plus de 50 000 prompts publics issus de plateformes comme ShareGPT et de recherches simulées sur les principaux agents IA. L’objectif : mesurer l’évolution de la longueur, de la structure et des intentions depuis 2025.

Chiffres clés : l’explosion de la longueur des prompts et l’émergence de nouveaux patterns

Sans langue de bois, les changements sont radicaux :

- Longueur moyenne : Un prompt pour une recherche commerciale sur ChatGPT-5 contient désormais 42 mots, contre 28 en 2025. L’utilisateur donne du contexte sans qu’on le lui demande.

- Incorporation de contexte : 78% des prompts incluent désormais un élément de cadre (« En tant que CTO d’une scale-up », « Pour un budget de 30k€ »).

- Demande de format : « Sous forme de tableau comparatif », « Donne-moi une checklist en 7 points » sont présents dans 65% des requêtes à visée décisionnelle.

Graphique : Évolution de la longueur moyenne des prompts (2024 : 18 mots → 2025 : 28 mots → 2026 : 42 mots).

Le ‘Query Fan Out’ confirmé : comment une question utilisateur se déploie en sous-requêtes

Reprenons l’exemple « logiciel cybersécurité PME ». L’utilisateur tape ça dans Google. En 2026, dans un agent IA, il va développer :

- « Quels sont les critères techniques à vérifier pour un SOC en interne ? »

- « Comparatif des solutions françaises vs internationales sur la détection d’intrusion. »

- « Checklist de déploiement pour une équipe de 5 personnes. »

C’est le Query Fan Out. L’IA, en interne, exécute ces sous-requêtes web et synthétise. Votre opportunité SEO n’est plus sur « logiciel cybersécurité ». Elle est nichée dans ces sous-questions hyper-spécifiques, peu concurrentielles et chargées d’intention.

Méthodologie pas-à-pas : appliquer le RPE pour auditer votre marché

Étape 1 : Collecter les réponses d’IA ‘parfaites’ dans votre niche

Ne cherchez pas loin. Allez sur les blogs de vos concurrents les plus techniques : ils utilisent déjà l’IA pour produire. Repérez les articles longs, bien structurés, avec des listes et tableaux. Ciblez aussi les réponses détaillées sur Perplexity, Claude.ai, ou les forums spécialisés (Substack, Reddit professionnel). Le critère : une réponse qui semble exhaustive et directement utile pour une prise de décision.

Étape 2 : Utiliser un outil de RPE pour inférer le prompt originel

En pratique, vous avez trois options en 2026 :

- Script Python basique (utilisant l’API OpenAI ou Anthropic) qui fait une optimisation par gradient pour approximer le prompt. On fournit un exemple simplifié en snippet.

- Services émergents : Des plateformes comme « PromptInverse » ou « RPE Studio » proposent une interface low-code. Souvent cher, mais rapide.

- Méthode heuristique manuelle : Pour une réponse donnée, décomposez-la et demandez-vous « Quelle instruction précise j’aurais dû donner pour obtenir exactement ce paragraphe, ce tableau ? ». C’est lent, mais forme l’œil.

Étape 3 : Analyser le prompt récupéré : décortiquer le rôle, la tâche, le contexte, la sortie (RTCO)

C’est le cœur de la méthode. Tout prompt efficace se décompose en :

- Rôle (R) : « Tu es un consultant senior en cybersécurité pour les institutions financières. » → DÉFINIT le persona et le niveau d’autorité.

- Tâche (T) : « Explique les différences entre une approche EDR et XDR. » → DÉFINIT le sujet central.

- Contexte (C) : « Pour une banque régionale de 500 collaborateurs soumise à la directive DORA. » → DÉFINIT les contraintes et l’angle.

- Sortie (O) : « Produis un tableau comparatif avec 5 lignes de critères et une recommandation finale. » → DÉFINIT le format et le call-to-action implicite.

Coloriez ces éléments dans le prompt récupéré. Si un élément manque, l’intention est floue.

Étape 4 : Traduire les éléments RTCO en axes de contenu et mots-clés pour votre site

C’est la transposition stratégique.

- Le Rôle → Votre persona acheteur principal. Ciblez votre ton, vos arguments sur ce profil.

- La Tâche + Contexte → Le sujet de l’article ou de la page de vente. « EDR vs XDR pour les banques soumises à DORA ».

- La Sortie → Le format de contenu à créer. L’utilisateur veut un tableau comparatif ? Créez-le. Il veut une checklist ? Publiez-la en PDF téléchargeable.

Cette transposition génère des mots-clés de longue traine ultra-précis : « tableau comparatif edr xdr coût banque ».

Étape 5 : Valider et itérer avec des outils de recherche sémantique

Ne faites pas confiance à un seul prompt. Utilisez les angles trouvés dans des outils comme Keyword Insights, AnswerThePublic (versions 2026), ou les « questions associées » de Google. Si vous voyez émerger les mêmes patterns, vous validez une intention de marché. Itérez sur 10-15 prompts récupérés pour cartographier tout un champ sémantique.

Cas pratique 2026 : Reverse Prompt Engineering pour une marque de formation en ligne

Le point de départ : une réponse d’IA générée pour ‘choisir une formation SEO’

[Image fictive : Capture d’écran d’une réponse détaillée de Claude 3.7 listant 7 critères de choix, un comparatif de formats (vidéo vs live), et un paragraphe sur l’importance des certifications reconnues.]

L’application de notre méthode : du prompt récupéré à la stratégie éditoriale

Prompt inféré : « Agis comme un responsable marketing ayant 10 ans d’expérience. Tu dois aider un entrepreneur qui lance une marketplace B2B à choisir une formation SEO avancée. Son budget est de 3000-5000€. Il a déjà des bases techniques. Fournis une liste de 7 critères décisifs de sélection, compare succinctement les formats vidéo pré-enregistré et coaching live, et explique l’impact des certifications sur la crédibilité auprès des clients. Structure la réponse avec des titres clairs. »

Analyse RTCO :

- Rôle : Responsable marketing senior (persona : décideur expérimenté, pas débutant).

- Tâche : Aider à choisir une formation SEO avancée.

- Contexte : Entrepreneur, marketplace B2B, budget 3k-5k€, bases techniques existantes.

- Sortie : Liste de 7 critères, comparaison de formats, explication sur les certifications, structure titrée.

Transposition en contenu :

- Page pilier : « Formation SEO Avancée : Le Guide du Décideur B2B (Budget 3k-5k€) ».

- Articles satellites : « 7 Critères pour Évaluer une Formation SEO (au-delà du prix) », « Coaching Live vs Vidéo : Quel Format pour Votre Apprentissage ? », « Les Certifications SEO Ont-elles une Vraie Valeur auprès des Clients ? ».

- Format : Guides longs avec listes, tableau comparatif, témoignages d’experts.

Résultats et recommandations pour la marque

La roadmap devient claire : produire d’abord le guide du décideur qui synthétise le RTCO complet, puis décliner chaque élément en contenu approfondi. Ciblage publicitaire sur les mots-clés reflétant le contexte (« formation seo marketplace b2b budget »). L’offre de formation doit elle-même répondre explicitement à ces 7 critères.

Limites, éthique et avenir du RPE

Les garde-fous éthiques et légaux (mise à jour RGPD/IA 2026)

Le RPE appliqué à du contenu public et anonyme est un outil d’étude de marché. Son application à des conversations privées, des prompts propriétaires d’entreprise, ou pour usurper une identité viole les conditions d’utilisation et potentiellement la loi. La directive européenne sur l’IA de 2026 encadre strictement l’extraction non autorisée de données de modèles. Utilisez cette méthode pour comprendre, pas pour copier ou tromper.

Les défis techniques : l’adaptation des modèles et le ‘Prompt Shielding’

Les fournisseurs de LLMs ne sont pas passifs. Le Prompt Shielding (brouillage intentionnel des réponses pour rendre l’inversion difficile) se généralise. Certains modèmes ajoutent un bruit aléatoire ou des paraphrases qui dégradent la précision du RPE. C’est une course technique, mais le principe reste valable : l’intention se lit dans la structure de la réponse, pas seulement dans les mots exacts.

Au-delà du SEO : autres applications prometteuses en 2026

En pratique, cette logique d’inférence sert ailleurs :

- Sécurité : Analyser les réponses d’un LLM pour détecter des fuites de données d’entraînement ou des vulnérabilités de manipulation.

- Éducation : Comprendre le raisonnement d’un modèle pour mieux enseigner le prompt engineering.

- Optimisation interne : Une entreprise peut auditer ses propres prompts métier pour identifier les formulations inefficaces et les standardiser.

Conclusion : Maîtriser la langue de l’IA pour anticiper les besoins humains

Le Reverse Prompt Engineering n’est pas une astuce. C’est une compétence de lecture critique du nouveau langage de la recherche. En 2026, gagner ne se fait plus en devinant les mots-clés, mais en comprenant les schémas de pensée que les utilisateurs confient aux agents conversationnels.

Cette méthode systématique transforme le bruit conversationnel en signaux exploitables. Elle aligne votre production de contenu sur l’intention réelle, souvent non-dite, de votre audience cible. Le résultat n’est pas plus de trafic, mais un trafic radicalement plus pertinent, avec un taux de conversion qui valide l’hypothèse de départ.

La répétition de ce processus crée la rentabilité. Le succès, finalement, n’est qu’une longue série d’intentions correctement décodées.

Questions Fréquemment Posées

Le Reverse Prompt Engineering, c’est exactement quoi ?

C’est une méthode qui consiste, à partir d’une réponse générée par une IA, à déduire le prompt le plus probable qui a conduit à cette réponse. L’objectif est de comprendre l’intention, le contexte et les attentes précises de l’utilisateur qui a formulé la requête originale.

En quoi le Reverse Prompt Engineering est-il différent du Prompt Engineering classique ?

Le Prompt Engineering part d’un besoin pour créer un prompt efficace. Le Reverse Prompt Engineering fait le chemin inverse : il part d’une réponse pour analyser et cartographier le besoin initial. C’est un outil d’analyse et de renseignement, pas de création directe.

Quels sont les outils gratuits pour faire du Reverse Prompt Engineering en 2026 ?

Vous pouvez utiliser des scripts Python open-source qui utilisent les APIs des LLMs (OpenAI, Anthropic) pour faire de l’optimisation inverse. Des notebooks Google Colab pré-configurés sont aussi disponibles. Les bookmarklets pour navigateur existent, mais sont moins précis. La méthode heuristique manuelle (analyse logique) reste une option gratuite et formateur.

Le Reverse Prompt Engineering est-il légal et éthique ?

Appliqué à du contenu public, anonyme et dans le but de comprendre des tendances de marché, c’est une pratique légitime d’étude. Il devient illégal et contraire à l’éthique s’il vise à extraire des prompts personnels, privés, ou propriétaires, ou à reproduire frauduleusement un style ou un contenu protégé. Respectez toujours les conditions d’utilisation des plateformes.

Combien de réponses d’IA sont nécessaires pour retrouver un prompt fiable ?

En pratique, 3 à 5 réponses de haute qualité sur un même sujet permettent d’obtenir une inférence fiable à plus de 85%. L’analyse croisée de plusieurs réponses permet de gérer la variance naturelle des modèles et d’identifier les éléments stables du prompt sous-jacent.

Comment les modèles d’IA se protègent-ils contre le Reverse Prompt Engineering ?

Les fournisseurs déploient des techniques de « Prompt Shielding » : ajout de bruit, paraphrases aléatoires, ou modifications subtiles dans les réponses pour brouiller les pistes d’inversion. C’est une course entre l’amélioration des techniques RPE et les contre-mesures des modèles.

Le Reverse Prompt Engineering peut-il vraiment améliorer mon référencement (SEO) ?

Oui, de manière radicale. En comprenant la structure profonde des requêtes conversationnelles (via le cadre RTCO), vous créez du contenu qui correspond exactement à l’intention émergente des utilisateurs. Cela se traduit par un meilleur alignement avec les moteurs de recherche conversationnels, un trafic plus qualifié et une amélioration des signaux d’engagement (temps passé, partages).

Peut-on utiliser cette technique sur les réponses de Google SGE (Search Generative Experience) ?

En théorie, oui. En pratique, c’est plus complexe car les réponses SGE sont des synthèses de multiples sources, souvent tronquées et protégées. La méthode reste valable pour analyser la structure et l’angle de la réponse générée, même si l’inversion mot-à-mot est plus difficile.

Quelles sont les limites du Reverse Prompt Engineering ?

Ses limites sont la qualité des réponses sources (mauvaises réponses donnent de mauvaises inférences), l’évolution des protections des modèles, et le fait qu’il révèle une intention probable, mais pas certaine. C’est un outil puissant pour générer des hypothèses, à valider ensuite par des tests et d’autres données marché.

Pouvez-vous donner un exemple concret de Reverse Prompt Engineering pour un site e-commerce ?

Imaginez un site vendant des panneaux solaires. Vous trouvez une réponse IA détaillée comparant les batteries lithium-fer-phosphate et plomb-acide pour l’autoconsommation. Le prompt inféré révèle un contexte précis : « pour une maison de 150m² en Bretagne, budget 8000€ ». Votre contenu doit alors cibler « comparatif batterie solaire maison 150m² bretagne » et vos fiches produits doivent parler autonomie en climat faible ensoleillement, pas en généralités.